大模型看书,从来没有这么快过。

国内大模型创业公司,正在技术前沿创造新的记录。

10月30日,百川智能正式发布 Baichuan2-192K 长窗口大模型,将大语言模型(LLM)上下文窗口的长度一举提升到了192K token。

这相当于让大模型一次处理约35万个汉字,长度达到了 GPT-4(32K token,约2.5万字)的14倍,Claude2.0(100K token,约8万字) 的4.4倍。

换句话说,Baichuan2-192K 可以一次性读完一本《三体2》,是全球处理上下文窗口长度最长的大模型。此外,它也在文本生成质量、上下文理解、问答能力等多个维度的评测中显著领先对手。

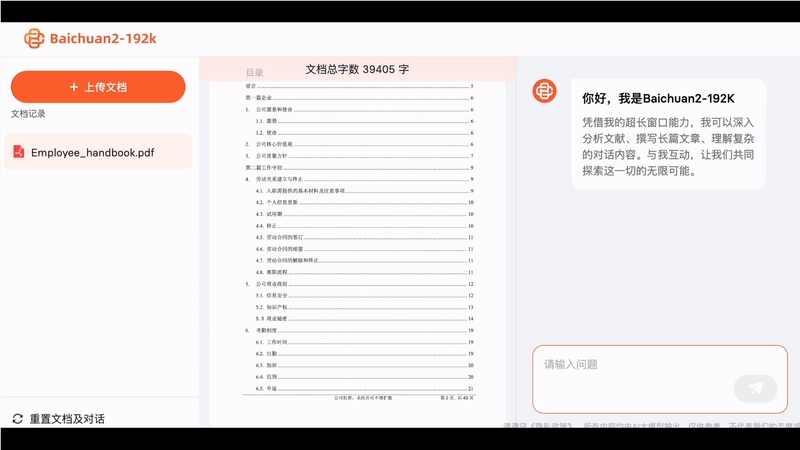

能够一次理解超长文本的大模型,究竟能做哪些事?百川智能进行了一番简单演示。

上传一整部《三体2:黑暗森林》的 PDF 文件,百川大模型统计出来是30万字。接下来,如果你询问有关这本小说里的任何问题,大模型都可以给出简洁准确的答案。

有时候我们寻求 AI 的帮助,并不是希望他们发挥想象力,而是要提取准确信息。有了 Baichuan2-192K,我们可以快速解读几十页,甚至几百页的合同文件,让 AI 快速给出简明摘要,四舍五入就是量子速读了:

那么如果我突然接到新任务,有一堆文件要看呢?

直接打包一起上传就可以了,百川大模型可以轻松把五篇新闻整合成一篇。

大模型能够理解的内容变长之后,应用的方向会越来越多。众所周知,长文本建模能力是很多场景能够应用落地的前提条件。这一次,百川做到了业内领先。

从几万字到几十万字,头部创业公司都在抢滩「长窗口」

如果你关注大模型在文本理解方向的应用,或许会注意到一个现象:一开始,大家用来测评模型能力的文本可能都是一些财报、技术报告,这些文本通常有十几页到几十页不等,字数通常也就几万字。但后来,测试文本逐渐演变为几个小时的会议记录,或者几十万字的长篇小说,竞争越来越激烈,难度也越来越大。

与此同时,宣称能理解更长上下文的大模型公司也越来越受关注。比如前段时间,宣称能实现100K token 上下文窗口的大模型 ——Claude 背后的公司 Anthropic 先后拿到了微软和谷歌数十亿美元的融资,将大模型军备竞赛推向了新的层面。

为什么这些公司都在挑战长文本?

首先从应用的角度来看,使用大模型来提高生产力的很多工作者都不免要处理很长的文本,比如律师、分析师、咨询师等,上下文窗口越大,这些人能用大模型做的事情就越广泛;其次,从技术的角度来看,窗口所能容纳的信息越多,模型在生成下一个字时可以参考的信息就越多,「幻觉」发生的可能性就越小,生成的信息就越准确,这是大模型技术落地的必要条件。所以,在想办法提升模型性能的同时,各家公司也在比拼谁能把上下文窗口做得更大,从而投放到更多的应用场景。

从前面展示的一些例子中可以看到,Baichuan2-192K 在文本生成质量和上下文理解方面表现都很出色。而且,在这些定性结果之外,我们还可以从一些定量评估数据中看到这一点。

Baichuan2-192K:文件越长,优势越明显

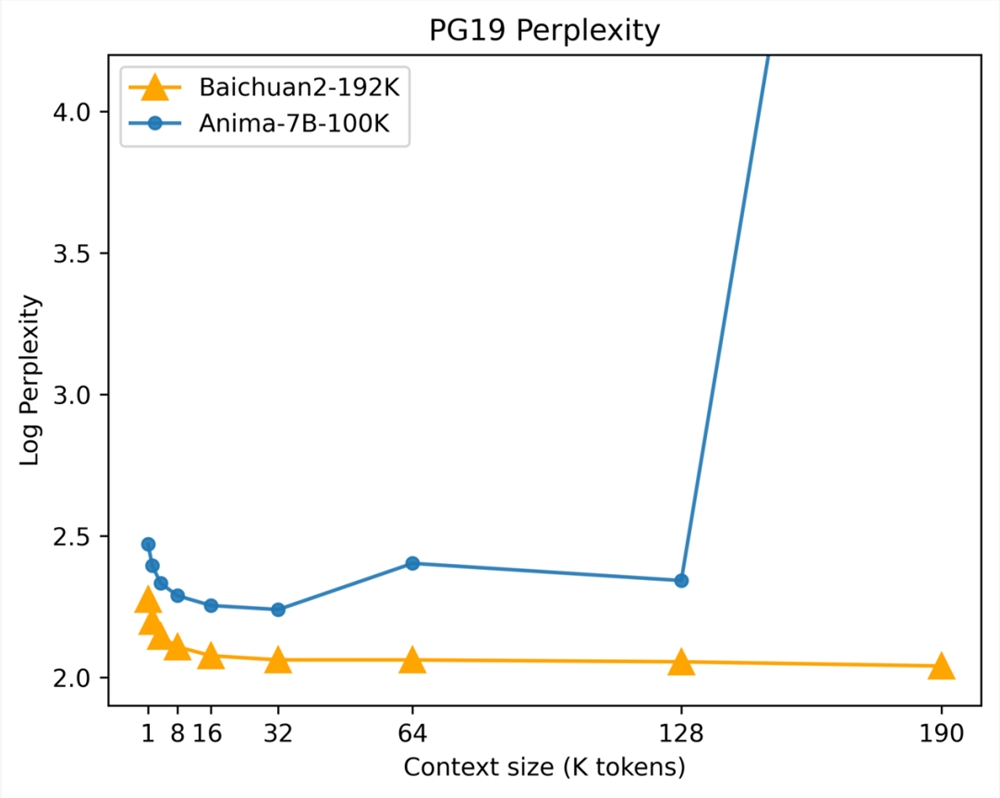

在文本生成质量评估中,一个很重要的指标叫「困惑度」:当我们将符合人类自然语言习惯的高质量文档作为测试集时,模型生成测试集中文本的概率越高,模型的困惑度就越小,模型也就越好。

用来测试百川大模型困惑度的测试集名叫 PG-19。这个数据集由 DeepMind 的研究人员制作,用来制作该数据集的资料来自古腾堡计划的图书,因此 PG-19具有书本级的质量。

测试结果如下图所示。可以看到,在初始阶段(横轴左侧,上下文长度比较短的阶段),Baichuan2-192K 的困惑度便处于较低的水准。随着上下文长度的增加,它的优势变得愈发明显,甚至呈现出困惑度持续下降的状态。这说明,在长上下文的场景中,Baichuan2-192K 更能保持书本级的文本生成质量。

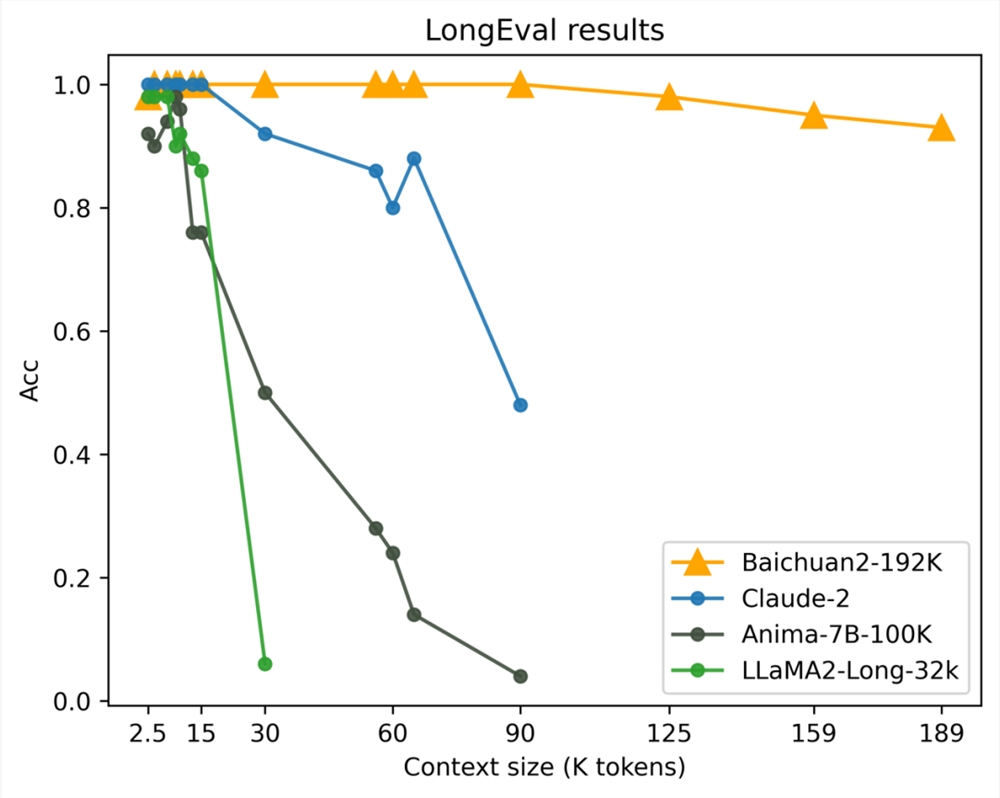

在上下文理解能力上,Baichuan2-192K 的表现也非常亮眼。

这项能力的评估采用了权威的长窗口文本理解评测基准 LongEval。LongEval 是由加州大学伯克利分校联合其他高校发布的针对长窗口模型评测的榜单,主要衡量模型对长窗口内容的记忆和理解能力,模型得分越高越好。

从下图的评估结果中可以看到,随着上下文长度的增加,Baichuan2-192K 一直能够保持稳定的高性能,在窗口长度超过100K 之后也是如此。相比之下,Claude2在窗口长度超过80K 后整体效果下降就已经非常严重。

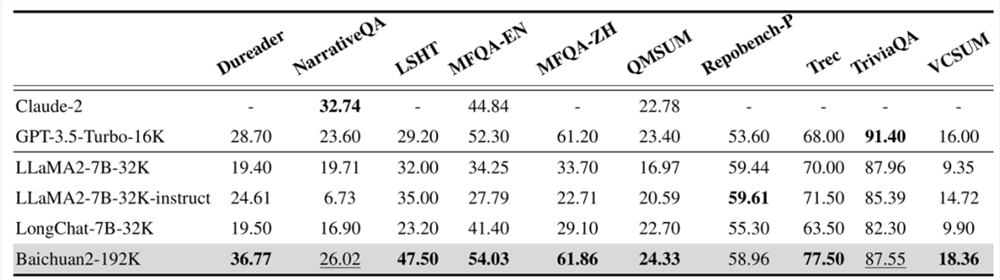

此外,模型还在 Dureader、NarrativeQA、TriviaQA、LSHT 等多个中英文长文本问答、摘要的评测集上经历了测试。结果显示,Baichuan2-192K 同样表现优异,在大部分长文本评测任务中都远超其他模型。

简而言之,处理的内容越长,百川的大模型相对性能就越好。

192K 超长上下文,百川是怎么做到的?

扩大上下文窗口能有效提升大模型性能是人工智能行业的共识,但是超长上下文窗口意味着更高的算力需求和更大的显存压力。

为了缓解这种压力,业内出现了一些折中的方法,比如把模型做小;让模型通过滑动窗口等方式主动抛弃前文,只保留对最新输入的注意力机制;通过对上下文的降采样或者 RAG(检索增强的生成),只保留对部分输入的注意力机制等等。

这些方式虽然能提升上下文窗口长度,但对模型的性能均有不同程度的损害。换言之,它们都是通过牺牲模型其他方面的性能来换取上下文窗口长度,比如模型无法基于全文信息回答复杂问题,难以跨多个文本综合考虑答案等。

而本次百川发布的 Baichaun2-192K通过算法和工程的极致优化,实现了窗口长度和模型性能之间的平衡,做到了窗口长度和模型性能的同步提升。

算法方面,百川智能提出了一种针对 RoPE 和 ALiBi 的动态位置编码的外推方案,该方案能够对不同分辨率的 ALiBi_mask 进行不同程度的 Attention-mask 动态内插,在保证分辨率的同时增强了模型对长序列依赖的建模能力。

工程方面,在自主开发的分布式训练框架基础上,百川智能整合了目前市场上所有先进的优化技术,包括张量并行、流水并行、序列并行、重计算以及 Offload 功能等,独创了一套全面的4D 并行分布式方案。该方案能够根据具体的负载情况,自动寻找最适合的分布式策略,极大地降低了长窗口推理过程中的显存占用。

打大模型之战,速度要快

成立于今年4月的百川智能,几乎可以说是业内技术迭代最快的大模型创业公司。在成立仅半年的时间里,这家公司就已经发布了 Baichuan-7B/13B、Baichuan2-7B/13B 四款开源可免费商用的大模型,以及 Baichuan-53B、Baichuan2-53B 两款闭源大模型。

平均下来,每个月就发布一款新的大模型。

Baichuan 系列大模型融合了意图理解、信息检索以及强化学习技术,结合有监督微调与人类意图对齐,在知识问答、文本创作领域表现突出。这些大模型也因为其能力在业内备受青睐:Baichuan 系列开源模型在各大开源社区的累积下载量已突破六百万次;Baichuan2更是在各维度全面领先 Llama2,引领了中国开源生态发展。

8月31日,百川智能率先通过《生成式人工智能服务管理暂行办法》,是首批8家公司中唯一一家今年创立的大模型公司。9月25日,百川智能开放 Baichuan API 接口,正式进军 To B 领域,开启商业化进程。

可以说,从技术研发到落地,百川的速度都足够快。

刚刚发布的 Baichuan2-192K 已经正式开启内测,将以 API 调用的方式开放给核心合作伙伴。百川表示,其已经与财经类媒体及律师事务所等机构达成了合作,把 Baichuan2-192K 领先的长上下文能力应用到了传媒、金融、法律等具体场景当中,不久后将以 API 调用和私有化部署的方式提供给企业用户。

以 API 的形式全面开放之后,Baichuan2-192K 能够与大量垂直场景深度结合,在人们的工作、生活、学习中发挥作用,助力行业用户大幅提升效率。Baichuan2-192K 能够一次性处理和分析数百页的材料,对于长篇文档关键信息提取与分析,长文档摘要、长文档审核、长篇文章或报告编写、复杂编程辅助等真实场景都有巨大的助力作用。

此前,百川智能创始人、CEO 王小川曾透露,今年下半年,百川将推出千亿级的大模型,明年预计会有 C 端的超级应用部署。

面对与 OpenAI 的差距,王小川坦言,在理想方面我们和 OpenAI 确实存在差距,OpenAI 的目标是探索智能的天花板,他们甚至希望设计出将1000万颗 GPU 连在一块的技术。但是,在应用方面我们比美国走得更快,互联网时代积累下来的应用和生态的经验,能让我们走的更快也更远,所以百川做大模型的理念,叫做「理想上慢一步,落地上快三步」。

由此来看,Baichuan2-192K 正是这种理念的延展,全球最长的上下文窗口无疑也将加速百川智能大模型技术落地的进程。

©THE END